À l’ère des technologies toujours plus évolutives, le machine learning ne cesse de se perfectionner pour s’adapter à des environnements dynamiques. Face à cette nécessité, l’apprentissage en continuation émerge comme une réponse novatrice capable de maintenir les performances des systèmes intelligents au fil des flux de données successifs. Ce paradigme, intimement lié à l’apprentissage automatique, vise à permettre aux algorithmes de s’adapter sans perdre les acquis déjà appris.

Dans le contexte actuel où les données séquentielles prolifèrent, des exemples d’applications concrètes abondent : des assistants personnels qui améliorent leur compréhension en continu, des véhicules autonomes qui apprennent de nouvelles situations sur la route, ou encore des systèmes de recommandation affinant leurs suggestions au fil du temps. Cette capacité à évoluer en intégrant des informations successives repose sur des modèles adaptatifs spécialement conçus pour pallier les faiblesses classiques du machine learning.

Un enjeu majeur est d’éviter le phénomène dit de catastrophic forgetting, où une mise à jour incrémentale efface ou dégrade brutalement les connaissances précédemment acquises. L’apprentissage supervisé traditionnel, bien que puissant, ne gère pas efficacement ce défi car il est souvent centré sur un apprentissage à partir d’un ensemble statique de données.

Grâce à des méthodes de transfert de connaissances et des architectures innovantes, le machine learning en continuation ouvre des perspectives inédites, notamment dans des domaines requérant une adaptabilité constante. Comprendre les bases de ce mécanisme est essentiel pour toute personne désireuse d’appréhender les nouvelles frontières de l’intelligence artificielle.

Comprendre le principe fondamental de l’apprentissage en continuation dans le machine learning

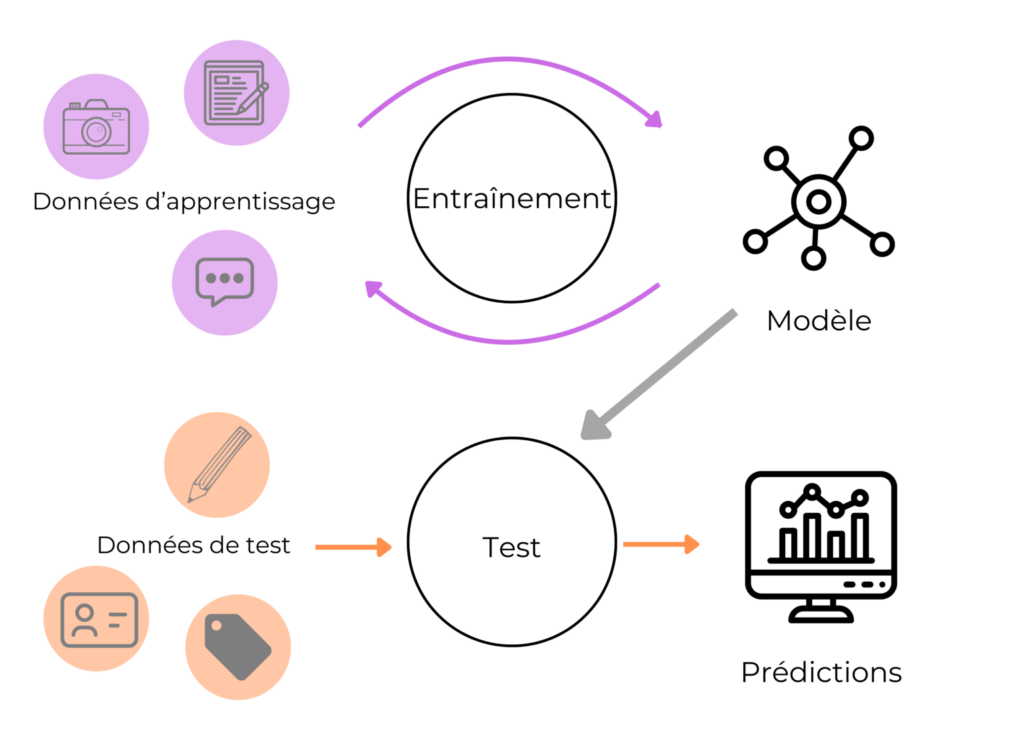

L’apprentissage en continuation, ou continual learning, consiste à entraîner des modèles capables d’assimiler des données successivement sans perdre les informations précédemment acquises. Cette approche répond à une problématique cruciale dans le traitement de données séquentielles : comment maintenir à jour un modèle avec de nouvelles données, tout en préservant ses performances sur des tâches déjà apprises ?

Contrairement à l’apprentissage classique supervisé, qui s’appuie sur un jeu de données figé et souvent conséquent pour effectuer une phase d’entraînement unique, l’apprentissage en continuation entraîne des modèles adaptatifs qui évoluent au fil de l’arrivée des nouvelles données. Ces données séquentielles viennent enrichir les capacités du modèle dans le temps.

Une difficulté majeure est que l’intégration de nouvelles données peut entraîner un phénomène nommé catastrophic forgetting. Ce phénomène correspond à la perte brutale des compétences antérieures lorsque le modèle est mis à jour uniquement avec de nouvelles informations. Pour illustrer, imaginons un réseau de neurones qui apprend à reconnaître des images de chats. Si l’entraînement continue seulement avec des images de chiens sans rappel des chats, le modèle peut « oublier » comment identifier un chat.

C’est dans ce contexte que l’apprentissage en continuation se distingue, car il cherche à équilibrer la préservation des connaissances et l’intégration du nouvel apprentissage. Parmi les stratégies mises en œuvre figurent :

- la régularisation des paramètres du modèle pour limiter les modifications trop importantes lors de l’apprentissage incrémental ;

- la mémorisation active de données clés déjà rencontrées, souvent appelée replay, où des exemples passés retravaillés participent à la consolidation des acquis ;

- la mise en place de modèles modulaires où différentes parties du réseau sont spécialisées dans des tâches spécifiques, réduisant les interférences.

Ces méthodes permettent une robustesse accrue face aux exigences de changement continu, rendant l’apprentissage en continuation incontournable pour les systèmes d’intelligence artificielle contemporains. Leur usage s’étend ainsi des applications industrielles à la recherche scientifique, en passant par la vie quotidienne des utilisateurs.

Le rôle des réseaux de neurones dans l’adaptation aux données séquentielles

Les réseaux de neurones occupent une place centrale dans le machine learning, notamment pour leurs capacités à apprendre des représentations complexes. Leur architecture flexible permet d’implémenter des modèles adaptatifs adaptés à l’apprentissage en continuation. Toutefois, intégrer des données séquentielles tout en évitant le catastrophic forgetting impose des architectures spécifiques et des mécanismes innovants.

Classiquement, un réseau de neurones est entraîné via l’apprentissage supervisé, par l’exemple, avec un ensemble statique de données. Mais dans un environnement de données séquentielles, ce principe n’est plus suffisant. Afin de renforcer leur adaptabilité, plusieurs approches ont vu le jour :

- Les réseaux à mémoire — tels que les LSTM (Long Short-Term Memory) ou les réseaux de neurones récurrents (RNN) — capables de garder une trace des informations dans le temps, facilitant le traitement de séquences longues.

- L’apprentissage par transfert — ici, le modèle profite d’une phase initiale pour apprendre une représentation générale, qu’il va ensuite spécialiser avec les nouvelles données sans repartir de zéro.

- Les architectures modulaires — où différentes sous-parties du réseau sont dédiées à des tâches spécifiques, permettant d’isoler l’apprentissage et de réduire les conflits entre tâches successives.

Un exemple parlant provient d’une entreprise simulée, nommée NormaIA, qui développe des assistants personnels intelligents. Grâce à des réseaux de neurones récurrents, leurs modèles s’adaptent continuellement aux habitudes de leurs utilisateurs tout en évitant la dégradation des connaissances passées. Ce procédé repose sur la mise à jour incrémentale des paramètres du réseau, avec un système de régularisation qui limite la perte d’information initiale.

On peut voir ces avancées comme une évolution du modèle « cerveau augmenté » où chaque nouvelle expérience affine la compréhension sans effacer ce qui a été appris auparavant. Le dialogue continu entre réseaux et flux de données séquentielles devient alors une clé pour des systèmes toujours plus intelligents et adaptatifs.

Techniques essentielles pour contrer le catastrophic forgetting dans l’apprentissage supervisé

Le catastrophe forgetting, ou oubli catastrophique, est une problématique centrale que l’apprentissage en continuation vise à atténuer. Son apparition souligne la fragilité des modèles traditionnels de machine learning lorsqu’ils sont confrontés à des données évolutives et à des tâches successives. Heureusement, de nombreuses techniques ont émergé pour remédier à cet obstacle dans le cadre de l’apprentissage supervisé.

La régularisation est l’une des méthodes clé. Elle consiste à contraindre l’évolution des paramètres du modèle durant les phases successives d’apprentissage afin qu’ils ne s’éloignent pas trop des valeurs optimales précédentes. Une technique notable est l’Elastic Weight Consolidation (EWC), qui applique une pénalité sur les modifications des paramètres fortement importants pour les tâches déjà apprises.

Une autre stratégie consiste en la réutilisation d’exemples passés, souvent désignée par le terme de « replay ». Le modèle conserve un petit échantillon représentatif des données anciennes, qu’il mélange avec les nouvelles lors de chaque mise à jour. Cette méthode s’apparente à la mémoire active de l’humain qui repasse régulièrement des souvenirs pour mieux les fixer.

Enfin, la modularité peut aussi réduire l’interférence entre anciennes et nouvelles connaissances. En divisant le réseau en sous-unités spécialisées, chaque segment apprend indépendamment, ce qui limite le chevauchement des représentations.

| Technique | Description | Avantages | Limites |

|---|---|---|---|

| Elastic Weight Consolidation (EWC) | Pénalisation des modifications des paramètres cruciaux | Maintient des connaissances clés | Coût computationnel élevé |

| Replay | Réintroduction d’exemples passés dans l’entraînement | Renforce la mémoire du modèle | Besoin de stockage additionnel |

| Approche Modulaire | Division en sous-réseaux spécialisés | Réduction des interférences entre tâches | Complexité de conception accrue |

Dans une application pratique, des chercheurs ont pu appliquer ces méthodes combinées pour entraîner un robot à accomplir diverses tâches domestiques. L’intégration d’un replay sous forme de simulation a permis d’obtenir une stabilité remarquable dans le comportement, évitant l’oubli d’actions déjà apprises.

Transfert de connaissances et mise à jour incrémentale dans les modèles adaptatifs

Un axe fondamental du succès de l’apprentissage en continuation repose sur les capacités de transfert de connaissances et de mise à jour incrémentale, deux concepts intimement liés qui permettent aux systèmes d’intelligence artificielle de s’enrichir avec efficacité.

Le transfert de connaissances implique qu’un modèle préalablement entraîné sur une tâche puisse réutiliser ce qu’il a appris pour accélérer ou améliorer l’apprentissage sur une nouvelle tâche. Cette approche, déjà répandue en apprentissage supervisé, revêt une importance encore plus grande dans le cadre des données séquentielles afin de limiter les efforts de réapprentissage et d’éviter la redondance.

La mise à jour incrémentale, quant à elle, désigne le processus par lequel un modèle est progressivement ajusté pour intégrer de nouvelles données au fil du temps, sans repartir de zéro. En combinant ces deux mécanismes, les modèles adaptatifs deviennent capables d’évoluer doucement mais sûrement, partageant leurs acquis pour résoudre de nouveaux défis tout en conservant leur savoir-faire initial.

Un exemple typique se trouve dans les plateformes de recommandations en ligne. Ces systèmes apprennent d’abord sur un large ensemble d’utilisateurs, puis se spécialisent rapidement selon chaque profil grâce à des mises à jour incrémentales. Le transfert de connaissances permet de ne pas repartir d’une base vierge, ce qui optimise la réactivité et la pertinence des recommandations.

Ces mécanismes demandent toutefois des algorithmes raffinés afin d’équilibrer entre adaptation rapide et préservation des acquis. Différents algorithmes, tels que les réseaux à double mémoire ou les optimisations régulières, assurent cette cohabitation harmonieuse.

- Recyclage efficace des savoirs précédents

- Réduction des temps d’entraînement

- Maintien de la performance globale du modèle

- Adaptabilité aux changements de la nature des données

- Robustesse face aux phénomènes de dérive conceptuelle

Applications concrètes et défis à relever pour le futur de l’apprentissage en continuation

L’apprentissage en continuation fait aujourd’hui figure de pilier pour l’évolution des systèmes intelligents dans des environnements complexes et mouvants. Ses applications sont multiples et touchent divers secteurs à fort enjeu technologique et humain.

Dans le domaine médical, par exemple, les modèles adaptatifs peuvent suivre les évolutions des données cliniques au fil du temps, améliorer les diagnostics et personnaliser les traitements sans risquer d’oublier les recherches antérieures. Dans le secteur industriel, la maintenance prédictive bénéficie d’un apprentissage continu grâce aux retours constants des capteurs sur les machines.

Malgré ces succès, plusieurs défis persistent. Il convient de continuer à affiner les méthodes pour gérer l’oubli catastrophique toujours présent dans certains cas extrêmes, concevoir des modèles économiques en ressources computationnelles afin que ces techniques soient accessibles à des échelles variées, et surtout, garantir l’éthique et la transparence dans la mise à jour des connaissances.

Une liste des enjeux majeurs se dessine :

- Amélioration des mécanismes anti-forgetting

- Optimisation de la mémoire et du stockage des modèles

- Gestion des biais qui peuvent s’accroître au fil des mises à jour

- Développement d’architectures hybrides combinant différents types d’apprentissage

- Adoption de standards pour assurer la reproductibilité et la transparence

Ces défis reflètent l’essence même de l’intelligence artificielle : son besoin constant de s’adapter, apprendre et évoluer. L’apprentissage en continuation se révèle donc un tournant essentiel, offrant la possibilité d’un dialogue fluide entre les modèles et la réalité complexe dans laquelle ils s’inscrivent.

Qu’est-ce que l’apprentissage en continuation ?

L’apprentissage en continuation désigne l’entraînement progressif de modèles capables d’intégrer de nouvelles données séquentielles tout en conservant leurs connaissances antérieures, évitant ainsi l’oubli catastrophique.

Comment le catastrophic forgetting impacte-t-il les modèles de machine learning ?

Le catastrophic forgetting conduit à une perte rapide des compétences acquises antérieurement lorsqu’un modèle est entraîné successivement sur de nouvelles tâches ou données, ce qui compromet sa performance globale.

Quelles sont les méthodes pour contrer le catastrophic forgetting ?

Plusieurs méthodes existent : régularisation des poids (comme l’Elastic Weight Consolidation), replay d’anciens exemples et architectures modulaires qui isolent l’apprentissage de différentes tâches.

Quel est le rôle des réseaux de neurones dans l’apprentissage continu ?

Les réseaux de neurones, particulièrement les architectures récurrentes et modulaires, constituent la base des systèmes adaptatifs qui permettent d’intégrer efficacement des données séquentielles et d’éviter l’oubli catastrophique.

En quoi le transfert de connaissances est-il crucial pour la mise à jour incrémentale ?

Le transfert de connaissances permet à un modèle de réutiliser ses acquis pour apprendre plus rapidement de nouvelles tâches, ce qui, combiné à une mise à jour incrémentale, optimise la performance et la stabilité du modèle dans le temps.